Comment Federated Averaging et Compression de Gradient Révolutionnent l'Apprentissage Fédéré avec TensorFlow

Vous rêvez de construire des modèles performants sur des données décentralisées ? L'apprentissage fédéré, et plus particulièrement l'approche Federated Averaging (FedAvg) combinée à la compression de gradient, pourrait bien être la solution. Découvrez comment cette technique peut transformer votre façon de travailler avec les données.

Réduire Drastiquement la Communication : Un Atout Majeur

La communication est souvent un goulet d'étranglement dans l'apprentissage fédéré. FedAvg, associé à la compression de gradient, permet une réduction de plus de 94% des coûts de communication. Cela ouvre la porte à des collaborations plus efficaces et à des déploiements à plus grande échelle.

- Moins de bande passante nécessaire.

- Déploiement sur des appareils aux ressources limitées facilité.

- Accélération significative du processus d'apprentissage.

Gérez les Données Hétérogènes : Un Défi Relevé

Les données "non-IID" (non identiquement distribuées) sont une réalité dans de nombreux contextes d'apprentissage fédéré. Federated Averaging est conçu pour gérer cette hétérogénéité, assurant une performance robuste même lorsque les ensembles de données sont très différents d'un participant à l'autre.

Protégez la Vie Privée : L'Apport de la Confidentialité Différentielle (DP)

La confidentialité est une priorité. L'intégration de la confidentialité différentielle (DP) dans Federated Averaging ajoute une couche de protection supplémentaire aux données sensibles. Ainsi, vous apprenez sans compromettre la vie privée des individus.

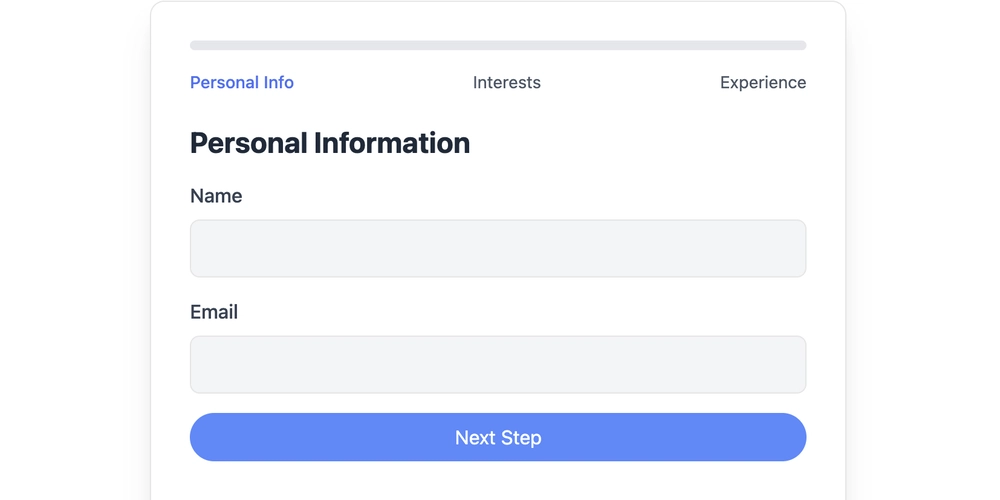

Codez avec TensorFlow Federated : Le Guide Pratique

Envie de passer à l'action ? TensorFlow Federated (TFF) est l'outil idéal pour implémenter Federated Averaging et bien d'autres techniques d'apprentissage fédéré. Retrouvez un guide complet pour vous lancer avec TFF et commencer à construire vos propres modèles fédérés. Ce guide vous permettra de comprendre comment implémenter Federated Averaging concrètement.

- Téléchargez et installez TensorFlow Federated.

- Adaptez des exemples de code pour vos besoins spécifiques.

- Explorez les différentes options de configuration.

L'Apprentissage Fédéré, une Solution d'Avenir ?

Federated Averaging et la compression de gradient représentent une avancée significative dans le domaine de l'apprentissage fédéré. En permettant de travailler sur des données décentralisées tout en réduisant les coûts de communication et en protégeant la vie privée, ces techniques ouvrent de nouvelles perspectives pour le développement de modèles d'intelligence artificielle innovants. Découvrez aussi comment optimiser Federated Averaging pour des cas d'usage spécifiques.